在物理、生命和社会等复杂系统中,构成要素同时相互关联的高阶相互作用在产生创造性变化和多样化行为方面发挥着本质性作用。这些高阶相互作用被认为参与了像大脑这样的生物网络中信息的表达,以及提升人工神经网络的性能。然而,迄今为止,尚未建立起能够基于一致原理看待这些问题的理论框架。

京都大学研究生院信息学研究科的岛崎秀昭副教授(兼北海道大学人类智能·大脑·AI研究教育中心客座副教授)、西班牙巴斯克应用数学中心的米格尔·阿基雷拉(Miguel Aguilera)研究员、株式会社ARAYA的巴勃罗·A·莫拉雷斯(Pablo A. Morales)主任、英国萨塞克斯大学的费尔南德·E·罗萨斯(Fernando E. Rosas)助教等人的国际联合研究团队扩展了统计物理学的最大熵原理,提出了一种在弯曲的统计流形上的新神经网络模型“Curved Neural Networks(曲面神经网络)”。该模型通过使用基于Renyi(雷尼)熵的变形指数分布,能够自然地融入传统仅描述成对相互作用的网络中无法实现的高阶相互作用,从而成为一个全新的框架。相关成果已发表在期刊《Nature Communications》上。

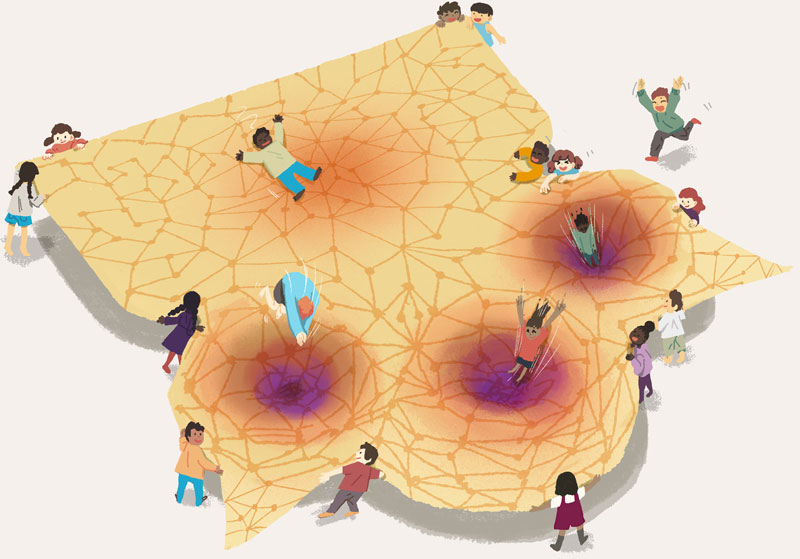

图1 以在弯曲的神经网络上玩耍的孩子表示爆发性记忆唤起(插图:Robin Hoshino)

研究团队首先将最大熵原理扩展到雷尼熵,构建了遵循变形指数分布而非传统指数型分布的概率神经网络模型。当变形参数为正值时,可以在正曲率统计流形(球面型)上构建神经网络;当变形参数为负值时,可以在负曲率统计流形(鞍型)上构建神经网络。因此,即使是像传统那样只描述成对相互作用的低阶模型,也能通过曲率(非线性)自然地呈现出包含高阶相关性的结构。

基于这一框架,研究人员进行了多种理论分析。通过平均场分析,理论上证明了有序-无序相变和自旋玻璃相变并非连续变化,而是以急剧变化的“爆发性相变”形式出现,并且存在多个记忆同时稳定的区域。此外,通过动态平均场分析和路径积分法,理论上证明了存在一种温度根据网络状态变化而变化的自我调节退火机制,使得记忆能够被加速唤起。利用副本法对记忆容量进行定量分析后,发现了负变形参数会增加记忆容量,而正变形参数会抑制虚假记忆的权衡结构。

此外,通过使用机器学习中常用的视觉图像数据集进行数值模拟,确认了记忆唤起的精度、速度以及虚假记忆的混入度会随曲率的调整而变化。

这些成果为统一理解记忆模型中的爆发性相变、多稳定性以及精度与容量的平衡控制提供了重要框架。

<研究者访谈>

加深了对大脑机制的理解

阿基雷拉研究员表示:“我们对本研究开辟的多种可能性抱有很大期望。捕捉生物神经细胞中高阶统计特征的新建模方法将进一步加深我们对大脑机制的理解。还将为图像和语言生成AI中使用的人工神经网络架构的信息编码能力的提升带来新的方法。我们认为,本框架将为探索自然智能和人工智能领域中信息处理的本质提供有力的线索”。

研究具有魅力的现象

莫拉雷斯主任表示:“论文用一种优雅的方法来理解复杂系统中高阶相互作用(HOIs)的影响。特别令人印象深刻的是,广义最大熵原理能够在不增加模型参数指数级增长的情况下有效捕捉HOIs,从而实现了对富有魅力现象的研究。这使得研究具有表现出爆发性有序-无序相变和多稳定性系统成为可能。这些并非硬编码,而是源自构建记忆空间的方法”。

以系统的自我控制为特点

罗萨斯助教表示:“我特别兴奋于发现了能引发具有高阶相互作用的系统发生爆发性相变的基本机制,即自我调节型退火。该机制类似于众所周知的模拟退火法,但其特点在于能量和温度之间存在独特的反馈,系统能够自我控制。反馈系统是生命系统的一个显著特征,而人工神经系统中出现这种自我控制机制,我觉得尤其具有吸引力”。

新的AI设计指南

岛崎副教授表示:“我想在弯曲的统计空间中构建神经网络,从理论上处理神经元的非线性和高阶相互作用!——这项研究从这样一个简单的想法开始,通过与对这个想法产生共鸣的同伴的交流得到了发展,并揭示了记忆唤起的意外行为。与伙伴们一同追踪意外进展的时间非常刺激。我们认为,本研究提出了实现记忆快速唤起和适应性控制的框架,并为AI提出了新的设计方针”。

原文:《科学新闻》

翻译:JST客观日本编辑部

【论文信息】

期刊:Nature Communications

论文:Explosive neural networks via higher-order interactions in curved statistical manifolds

DOI:doi.org/10.1038/s41467-025-61475-w