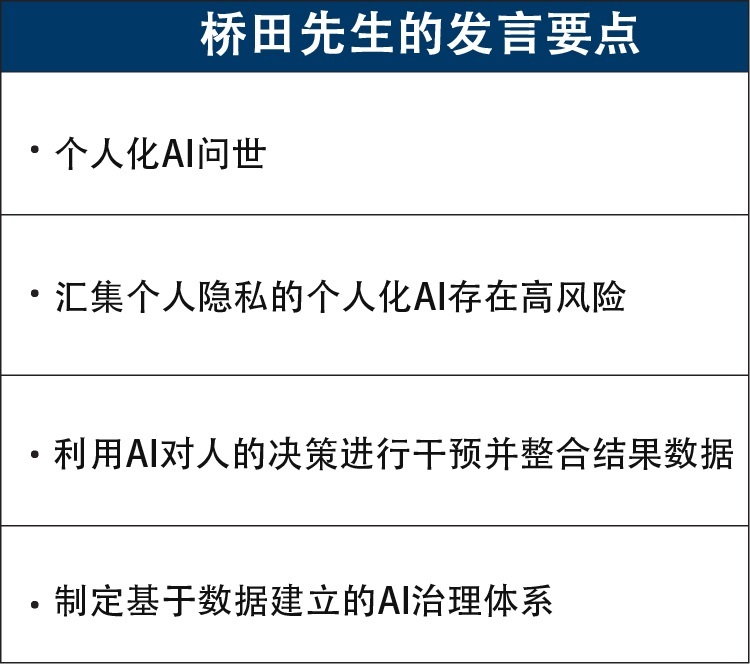

人工智能(AI)和自然语言处理领域的东京大学桥田浩一教授预测,不久的将来,面向个人的AI服务将会面世。这种个人化AI可以集中管理商品的购买记录、活动记录、健康诊断结果等信息,然后根据个人的喜好和需求提供相应的商品和服务。桥田浩一教授指出这类服务的风险管理愈加重要,需要制定新的规则。

东京大学研究生院信息理工学研究科桥田浩一教授

——大语言模型(LLM)的生成式AI正在不断融入人们的生活。

“个人化AI服务终将出现。各种服务和内容被整合到一起,AI将成为个人信息门户。美国微软的联合创始人比尔·盖茨等人也表达过同样的观点。将可以整合知识的AI进行个性化定制是必然的结果。”

“例如,亚马逊日本(东京目黑区)提供了名为‘亚马逊安心邮件'的服务。如果在亚马逊购买尿布和蜂蜜,就会收到一封提醒您‘不要给不满一岁的婴儿喂蜂蜜'的电子邮件。如果没有同时购买这两样商品,就不会发送此邮件。”

“如果个人化AI能够完全掌握用户的购买历史,这是完全可以做到的。尝试向ChatGPT咨询也会得到同样的回答。”

——更加便利的同时,也可能伴随着更高的风险。

“个人专属的AI将会访问并利用比以往更庞大且敏感的个人数据来为用户提供服务。如果能保证个人的秘密和隐私绝对不会泄露,并得到用户足够信任,才能把一切都委托给AI。”

“相反,充分利用个人数据也意味着,如果程序存在漏洞或学习数据存在偏差,风险将会增加。提供AI服务的企业也需要管理这种风险。”

——目前对AI监管的讨论是否不够?

“欧盟(EU)采取了基于风险的方法对AI进行监管,但几乎无法预测AI的具体风险。分析AI服务对个人造成了什么影响,需要同时考虑AI对用户决策的干预以及其结果的数据。目前提倡第三方能够分析其利弊的‘扩展数据可移植性'”。

——这是否意味着需要建立基于数据而非事先规定的第三方验证机制?

“需要分析数据,来灵活检测各种风险。也可以用于AI的审查和服务改进。因此,需要制定相关法律法规。国际标准化组织(ISO)已经成立了一个专门委员会,负责相关专业术语的标准化以及与AI相关的标准化,并开始讨论这些问题。我们希望这能对各国的规则制定产生一定的约束影响。”

商业化和用户视角

比尔·盖茨正在与微软合作的项目之一是“个人助理”。它在个人设备上运行,存储一切信息,并帮助选择需要关注的事物和注意点。

个人化AI是商业化AI的一种方式。但是,如果过于看重AI提供商的利益,而不是用户的利益,可能会引发问题。橋田先生指出,为了分析AI对个人的影响,需要同时收集来自AI的干预用户决策的数据以及其结果的数据。

产生巨大影响的生成式AI正在推动企业的研发。用户需要在认识到负面影响的前提下探索其应用方法。

日文:大豆生田崇志、《日经产业新闻》、2023/8/28

中文:JST客观日本编辑部